随着大数据和计算能力的飞速发展,深度学习作为人工智能领域的一个重要分支,已经引起了广泛的关注和研究。深度学习通过模拟人脑神经网络的运作方式,使得机器能够学习并理解数据的内在规律和特征,从而实现更高级别的智能化。本文将深入探讨深度学习的基本原理、关键技术及其在各个领域的应用。

一、深度学习的基本原理

深度学习的基础是神经网络,特别是深度神经网络。神经网络由大量的神经元(节点)相互连接而成,每个神经元接受输入信号并产生输出信号,通过不断调整连接权重来学习数据的特征。深度神经网络则是由多层神经元堆叠而成的复杂网络结构,通过逐层提取和抽象数据特征,实现对输入数据的高效表征和学习。

深度学习的核心在于如何训练神经网络,即调整网络中各个节点的权重。这通常通过反向传播算法和梯度下降算法来实现。反向传播算法用于计算损失函数对网络权重的梯度,而梯度下降算法则根据这些梯度来更新权重,使得网络在训练过程中逐渐逼近最优解。

二、深度学习的关键技术

卷积神经网络(CNN) 卷积神经网络是深度学习中最常用的网络结构之一,特别适用于处理图像数据。它通过卷积操作来提取图像的局部特征,并通过池化操作来降低数据维度和减少计算量。卷积神经网络在图像分类、目标检测、图像分割等任务中取得了显著成果。

循环神经网络(RNN) 循环神经网络适用于处理序列数据,如自然语言文本、时间序列等。它通过引入循环单元来记忆历史信息,从而实现对序列数据的建模。长短时记忆网络(LSTM)和门控循环单元(GRU)是循环神经网络中常用的变体,它们通过引入门控机制和记忆单元来增强网络的记忆能力和稳定性。

生成对抗网络(GAN) 生成对抗网络是一种由生成器和判别器组成的深度学习模型,通过两者的对抗训练来生成高质量的数据样本。生成器负责生成假数据,而判别器则负责判断输入数据是否真实。通过对抗训练,生成器能够逐渐学习到真实数据的分布,从而生成更加逼真的数据样本。GAN在图像生成、语音合成等领域具有广泛应用。

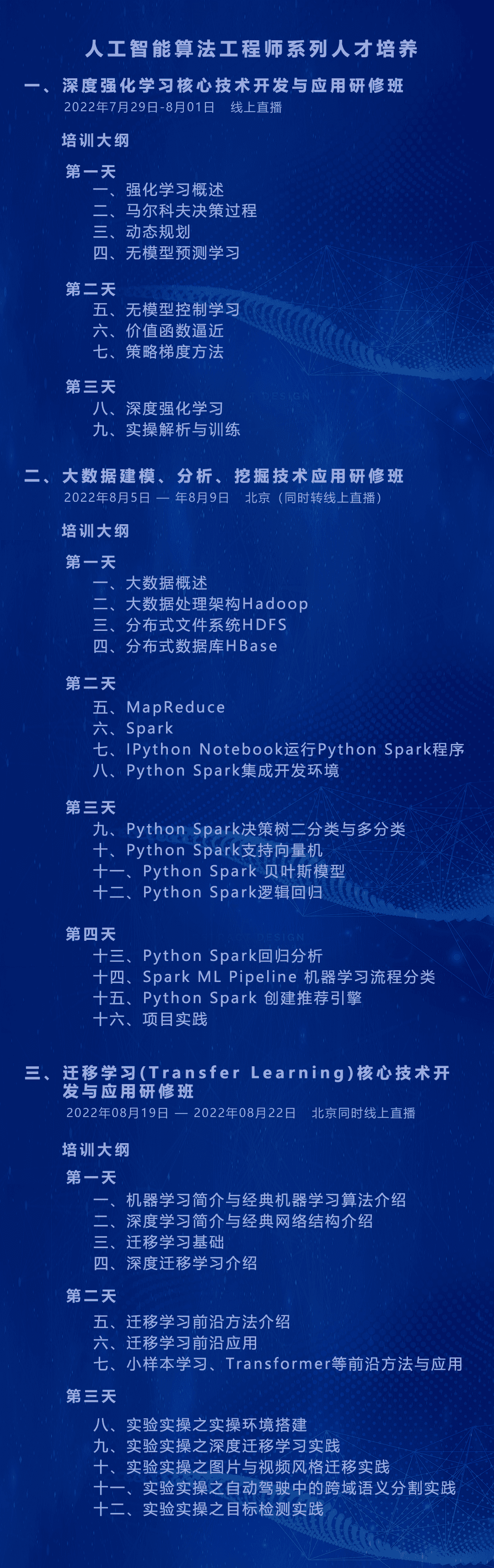

迁移学习 迁移学习是一种利用已有知识来解决新问题的技术。在深度学习中,迁移学习通常表现为将一个预训练好的模型迁移到一个新的任务中,通过微调部分网络层来实现对新任务的适应。迁移学习可以大大缩短模型的训练时间,提高模型的泛化能力,特别是在数据稀缺或标注成本高的场景下具有显著优势。

三、深度学习的应用领域

计算机视觉 深度学习在计算机视觉领域取得了显著突破,如图像分类、目标检测、图像分割等任务。通过训练深度神经网络,机器能够自动识别和解析图像中的物体、场景和事件,为自动驾驶、安防监控、医学影像分析等领域提供了有力支持。

自然语言处理 深度学习在自然语言处理领域也取得了重要进展,如机器翻译、文本分类、情感分析等任务。通过训练循环神经网络或Transformer等模型,机器能够理解和生成自然语言文本,实现人机之间的智能交互。

语音识别与合成 深度学习在语音识别和语音合成方面也取得了显著成果。通过训练深度神经网络来提取语音特征并识别语音内容,实现了高精度的语音识别系统。同时,利用生成对抗网络等技术,可以生成高质量的语音样本,为语音合成和虚拟助手等应用提供了技术支持。

推荐系统 深度学习在推荐系统领域也发挥着重要作用。通过训练深度神经网络来提取用户和物品的特征,并学习用户与物品之间的复杂关系,可以为用户提供更加精准和个性化的推荐服务。

四、结论与展望

深度学习作为人工智能领域的重要分支,已经在多个领域取得了显著成果。随着计算能力的不断提升和算法的不断优化,深度学习将在未来发挥更加重要的作用。然而,深度学习也面临着一些挑战,如数据隐私、模型可解释性等问题。因此,未来的研究需要关注如何克服这些挑战,推动深度学习技术的进一步发展。

总之,深度学习作为一种强大的机器学习技术,已经为各个领域带来了革命性的变革。随着技术的不断进步和应用场景的不断拓展,我们有理由相信深度学习将在未来发挥更加重要的作用,为人类创造更加美好的未来。

亲自试试ai吊炸天的一键去依功能吧

亲自试试ai吊炸天的一键去依功能吧